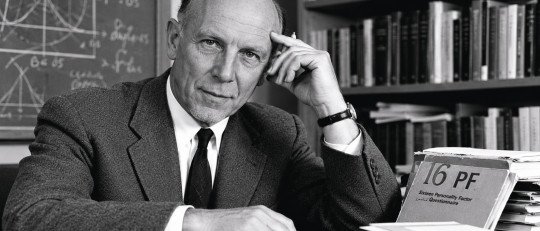

El experimento mental de la habitación china es una situación hipotética planteada por el el filósofo estadounidense John Searle, para demostrar que la capacidad de manipular ordenadamente un conjunto de símbolos no necesariamente implica que exista una comprensión o un entendimiento lingüístico de esos símbolos. Es decir, que la capacidad de entender no surge de la sintaxis, con lo cual, queda cuestionado el paradigma computacional que han desarrollado las ciencias cognitivas para comprender el funcionamiento de la mente humana.

En este artículo veremos en qué consiste exactamente este experimento mental y qué clase de debates filosóficos ha generado.

- Artículo relacionado: "¿En qué se parecen la Psicología y la Filosofía?"

La máquina de Turing y el paradigma computacional

El desarrollo de la inteligencia artificial es uno de los grandes intentos del siglo XX por comprender e incluso replicar la mente humana mediante el uso de programas computacionales. En este contexto, uno de los modelos más populares ha sido el de la máquina de Turing.

Alan Turing (1912-1954) quería demostrar que una máquina programada puede sostener conversaciones como un ser humano. Para esto, propuso una situación hipotética basada en la imitación: si programamos a una máquina para que imite la capacidad lingüística de los hablantes, después la ponemos ante un conjunto de jueces, y logra que el 30% de estos jueces piensen que están hablando con una persona real, esto sería evidencia suficiente para demostrar que una máquina puede ser programada de tal manera que replique los estados mentales de los seres humanos; y viceversa, también este sería un modelo explicativo de cómo los estados mentales humanos funcionan.

A partir del paradigma computacional, una parte de la corriente cognitiva sugiere que la forma más eficiente de adquirir conocimiento sobre el mundo es mediante la reproducción cada vez más perfeccionada de las reglas de procesamiento de información, de manera que, independientemente de la subjetividad o a la historia de cada quien, podríamos funcionar y responder en sociedad. Así, la mente sería una copia exacta de la realidad, es el lugar de conocimiento por excelencia y la herramienta para representar el mundo exterior.

Después de la máquina de Turing incluso se programaron algunos sistemas computacionales que intentaban pasar el test. Uno de los primeros fue ELIZA, diseñado por Joseph Weizenbaum, que respondía a los usuarios mediante un modelo registrado previamente en una base de datos, con lo cual logró que algunos interlocutores creyeran que hablaban con una persona.

Entre los inventos más recientes que guardan similitud con la máquina de Turing encontramos, por ejemplo, los CAPTCHA para detectar Spam, o SIRI del sistema operativo iOS. Pero, así como ha habido quienes intentan demostrar que Turing tenía razón, también ha ha habido quienes lo ponen en duda.

- Quizás te interese: "El Problema de Molyneux: un curioso experimento mental"

La habitación china: ¿funciona la mente como un ordenador?

A partir de los experimentos que buscaban aprobar el test de Turing, John Searle distingue entre Inteligencia Artificial Débil (la que simula el entendimiento, pero sin estados intencionales, es decir, describe la mente pero no la iguala); y la Inteligencia Artificial Fuerte (cuando la máquina tiene estados mentales como los de los seres humanos, por ejemplo, si puede entender las historias como lo hace una persona).

Para Searle es imposible crear Inteligencia Articial Fuerte, lo que quiso comprobar mediante un experimento mental conocido como la habitación china o la pieza china. Dicho experimento consiste en plantear una situación hipotética que es la siguiente: un hablante nativo de inglés, que no sabe chino, está encerrado en una habitación y debe responder preguntas sobre una historia que le han narrado en chino.

¿Cómo las responde? Mediante un libro de reglas escritas en inglés que sirven para ordenar sintácticamente los símbolos chinos sin explicar su significado, sólo explicando cómo se deben utilizar. Mediante este ejercicio, las preguntas son respondidas adecuadamente por la persona que está dentro de la habitación, aun cuando esta persona no ha entendido su contenido.

Ahora, supongamos que hay un observador externo ¿qué es lo que ve? Que la persona que está dentro de la habitación se comporta exactamente igual que una persona que sí entiende chino.

Para Searle, esto demuestra que un programa de computador puede imitar una mente humana, pero esto no significa que el programa de computador sea igual a una mente humana, porque no tiene capacidad semántica ni tampoco intencionalidad.

Impacto en la comprensión de la mente humana

Llevado al terreno de los humanos, lo anterior quiere decir que el proceso por medio del cual desarrollamos la capacidad de comprender un lenguaje va más allá de disponer de un conjunto de símbolos; son necesarios otros elementos que los programas computacionales no pueden tener.

No solo eso sino que, a partir de este experimento se han ampliado los estudios sobre cómo se construye el significado, y en dónde está ese significado. Las propuestas son muy diversas, van desde perspectivas cognitivistas que dicen que está en la cabeza de cada persona, derivados de un conjunto de estados mentales o que están dados de forma innata, hasta perspectivas más construccionistas que se preguntan cómo se construyen socialmente sistemas de reglas y prácticas que son históricas y que dan un sentido social (que un término tiene un significado no por estar en la cabeza de las personas, sino porque entra en un conjunto de prácticas reglas del lenguaje).

Críticas al experimento mental de la habitación china

Algunos investigadores que no están de acuerdo con Searle piensan que el experimento es inválido porque, aunque la persona que se encuentra dentro de la habitación no comprenda chino, puede ser que, en conjunto con los elementos que le rodean (la misma habitación, elinmobiliario, el manual de reglas), sí exista una comprensión de chino.

Ante esto, Searle responde con una nueva situación hipotética: aún si desaparecemos los elementos que rodean a la persona que está dentro de la habitación, y le pedimos que memorice los manuales de reglas para manipular los símbolos chinos, esta persona no estaría comprendiendo chino, lo cual, tampoco hace un procesador computacional.

La respuesta a esta misma crítica ha sido que la habitación china es un experimento técnicamente imposible. A su vez, la respuesta a esto ha sido que el que sea técnicamente imposible no significa que sea lógicamente imposible.

Otra de las críticas más populares ha sido la que realizan Dennett y Hofstadter, que aplican no solo al experimento de Searle sino al conjunto de experimentos mentales que se han desarrollado en los últimos siglos, ya que la confiabilidad es dudosa porque no tienen una realidad empírica rigurosa, sino especulativa y cercana al sentido común, con lo cual, son ante todo una “bomba de intuiciones”.

Referencias bibliográficas:

- González, R. (2012). La Pieza China: ¿un experimento mental con sesgo cartesiano?. Revista Chilena de Neuropsicología, 7(1): 1-6.

- Sandoval, J. (2004). Representación, discursividad y acción situada. Introducción crítica a la psicología social del conocimiento. Universidad de Valparaíso: Chile.

- González, R. (S/A). “Bombas de intuiciones”, mente, materialismo y dualismo: ¿Verificación, refutación o epoché?. Repositorio de la Universidad de Chile. [En línea]. Consultado 20 de abril de 2018. Disponible en http://repositorio.uchile.cl/bitstream/handle/2250/143628/Bombas%20de%20intuiciones.pdf?sequence=1.

-small.jpg)

-small-21_9.jpg)